Autoregressive Modelle sind eine Klasse statistischer Modelle, die in verschiedenen Bereichen weit verbreitet sind, darunter Verarbeitung natürlicher Sprache, Zeitreihenanalyse und Bildgenerierung. Diese Modelle sagen eine Wertefolge auf der Grundlage zuvor beobachteter Werte voraus und eignen sich daher gut für Aufgaben mit sequenziellen Daten. Autoregressive Modelle haben sich als äußerst effektiv bei der Generierung realistischer Daten und der Vorhersage zukünftiger Ergebnisse erwiesen.

Die Entstehungsgeschichte autoregressiver Modelle und ihre erste Erwähnung

Das Konzept der Autoregression geht auf das frühe 20. Jahrhundert zurück, als der britische Statistiker Yule 1927 Pionierarbeit leistete. Den Grundstein für moderne autoregressive Modelle legte jedoch die Arbeit des Mathematikers Norbert Wiener in den 1940er Jahren. Wieners Forschungen zu stochastischen Prozessen und Vorhersagen legten den Grundstein für die Entwicklung autoregressiver Modelle, wie wir sie heute kennen.

Der Begriff „autoregressiv“ wurde erstmals Ende der 1920er Jahre von Ragnar Frisch in der Wirtschaftswissenschaft eingeführt. Frisch verwendete diesen Begriff zur Beschreibung eines Modells, das eine Variable anhand ihrer eigenen verzögerten Werte regressiert und so die Abhängigkeit einer Variablen von ihrer eigenen Vergangenheit erfasst.

Autoregressive Modelle: Detaillierte Informationen

Autoregressive (AR) Modelle sind wichtige Werkzeuge in der Zeitreihenanalyse und werden verwendet, um zukünftige Werte auf der Grundlage historischer Daten vorherzusagen. Diese Modelle gehen davon aus, dass vergangene Werte aktuelle und zukünftige Werte linear beeinflussen. Sie werden häufig in der Wirtschaft, im Finanzwesen, bei der Wettervorhersage und in verschiedenen anderen Bereichen verwendet, in denen Zeitreihendaten vorherrschen.

Mathematische Darstellung

Ein autoregressives Ordnungsmodell (AR(p)) wird mathematisch wie folgt ausgedrückt:

Wo:

- ist der Wert der Reihe zum Zeitpunkt .

- sind die Koeffizienten des Modells.

- sind die vergangenen Werte der Reihe.

- ist der Fehlerterm zum Zeitpunkt , normalerweise wird angenommen, dass es sich um weißes Rauschen mit einem Mittelwert von Null und konstanter Varianz handelt.

Festlegen der Reihenfolge (p)

Die Bestellung eines AR-Modells ist entscheidend, da es die Anzahl der in das Modell einzubeziehenden Beobachtungen aus der Vergangenheit bestimmt. Die Wahl von beinhaltet einen Kompromiss:

- Niedrigere Ordnung Modelle (klein ) erfasst möglicherweise nicht alle relevanten Muster in den Daten, was zu einer Unteranpassung führen kann.

- Auftrag von oben Modelle (groß ) kann komplexere Muster erfassen, es besteht jedoch die Gefahr einer Überanpassung, bei der das Modell zufälliges Rauschen anstelle des zugrunde liegenden Prozesses beschreibt.

Gängige Methoden zur Ermittlung der optimalen Reihenfolge enthalten:

- Partielle Autokorrelationsfunktion (PACF): Identifiziert die signifikanten Verzögerungen, die einbezogen werden sollten.

- Informationskriterien: Kriterien wie das Akaike-Informationskriterium (AIC) und das Bayesianische Informationskriterium (BIC) gleichen Modelleignung und Komplexität aus, um ein geeignetes .

Modellschätzung

Schätzung der Parameter beinhaltet die Anpassung des Modells an historische Daten. Dies kann mit Techniken wie den folgenden erfolgen:

- Kleinste-Quadrate-Schätzung: Minimiert die Summe der quadrierten Fehler zwischen den beobachteten und vorhergesagten Werten.

- Maximum-Likelihood-Schätzung: Findet die Parameter, die die Wahrscheinlichkeit der Beobachtung der gegebenen Daten maximieren.

Modelldiagnose

Nach der Anpassung eines AR-Modells ist es wichtig, dessen Eignung zu bewerten. Zu den wichtigsten Diagnoseprüfungen gehören:

- Residuenanalyse: Stellt sicher, dass Residuen (Fehler) weißem Rauschen ähneln und keine Muster anzeigen, die vom Modell nicht erklärt werden.

- Ljung-Box-Test: Bewertet, ob sich eine der Autokorrelationen der Residuen signifikant von Null unterscheidet.

Anwendungen

AR-Modelle sind vielseitig und finden Anwendung in verschiedenen Bereichen:

- Wirtschaft und Finanzen: Prognose von Aktienkursen, Zinssätzen und Konjunkturindikatoren.

- Wettervorhersage: Vorhersage von Temperatur- und Niederschlagsmustern.

- Maschinenbau: Signalverarbeitungs- und Steuerungssysteme.

- Bio-Statistiken: Modellierung biologischer Zeitreihendaten.

Vorteile und Einschränkungen

Vorteile:

- Einfachheit und leichte Implementierung.

- Klare Interpretation der Parameter.

- Wirksam für kurzfristige Prognosen.

Einschränkungen:

- Nimmt lineare Beziehungen an.

- Kann für Daten mit starker Saisonalität oder nichtlinearen Mustern unzureichend sein.

- Sensibel bei der Wahl der Reihenfolge .

Beispiel

Betrachten Sie ein AR(2)-Modell (Ordnung 2) für Zeitreihendaten: Hier der Wert zum Zeitpunkt hängt von den Werten der beiden vorherigen Zeitpunkte ab, mit Koeffizienten von 0,5 bzw. 0,2.

Analyse der Hauptmerkmale autoregressiver Modelle

Autoregressive Modelle bieten mehrere wichtige Funktionen, die sie für verschiedene Anwendungen wertvoll machen:

- Sequenzvorhersage: Autoregressive Modelle eignen sich hervorragend für die Vorhersage zukünftiger Werte in einer zeitlich geordneten Abfolge und sind daher ideal für die Zeitreihenprognose geeignet.

- Generative Fähigkeiten: Diese Modelle können neue Datenbeispiele generieren, die den Trainingsdaten ähneln, wodurch sie für die Datenerweiterung und kreative Aufgaben wie die Text- und Bilderstellung nützlich sind.

- Flexibilität: Autoregressive Modelle können unterschiedliche Datentypen verarbeiten und sind nicht auf eine bestimmte Domäne beschränkt, sodass sie in verschiedenen Bereichen angewendet werden können.

- Interpretierbarkeit: Die Einfachheit der Modellstruktur ermöglicht eine leichte Interpretation seiner Parameter und Vorhersagen.

- Anpassungsfähigkeit: Autoregressive Modelle können sich an veränderte Datenmuster anpassen und im Laufe der Zeit neue Informationen integrieren.

Arten von autoregressiven Modellen

Autoregressive Modelle gibt es in verschiedenen Formen, jede mit ihren eigenen spezifischen Merkmalen. Zu den wichtigsten Arten von autoregressiven Modellen gehören:

- Autoregressive Modelle mit gleitendem Durchschnitt (ARMA): Kombiniert Autoregression und gleitende Durchschnittskomponenten, um sowohl aktuelle als auch vergangene Fehler zu berücksichtigen.

- Autoregressive integrierte gleitende Durchschnittsmodelle (ARIMA): Erweitert ARMA durch Einbeziehung der Differenzbildung, um Stationarität in nichtstationären Zeitreihendaten zu erreichen.

- Saisonale autoregressive integrierte gleitende Durchschnittsmodelle (SARIMA): Eine saisonale Version von ARIMA, geeignet für Zeitreihendaten mit saisonalen Mustern.

- Vektorautoregressive Modelle (VAR): Eine multivariate Erweiterung autoregressiver Modelle, die verwendet wird, wenn sich mehrere Variablen gegenseitig beeinflussen.

- Long Short-Term Memory (LSTM)-Netzwerke: Eine Art rekurrierendes neuronales Netzwerk, das weitreichende Abhängigkeiten in sequenziellen Daten erfassen kann und häufig bei der Verarbeitung natürlicher Sprache und bei Spracherkennungsaufgaben verwendet wird.

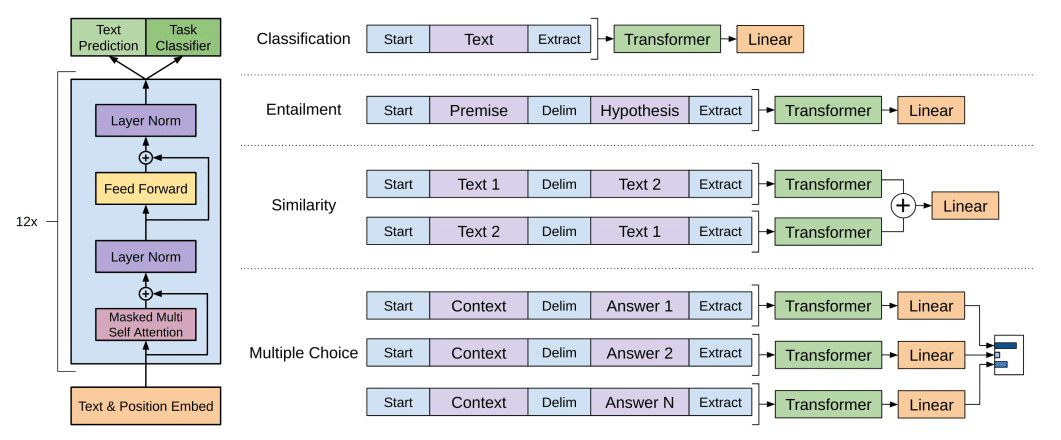

- Transformatormodelle: Eine Art neuronale Netzwerkarchitektur, die Aufmerksamkeitsmechanismen zur Verarbeitung sequentieller Daten verwendet und für ihren Erfolg bei der Sprachübersetzung und Textgenerierung bekannt ist.

Hier ist eine Vergleichstabelle, die die Hauptmerkmale dieser autoregressiven Modelle zusammenfasst:

| Modell | Hauptmerkmale | Anwendung |

|---|---|---|

| ARMA | Autoregression, gleitender Durchschnitt | Zeitreihenprognose |

| ARIMA | Autoregression, integriert, gleitender Durchschnitt | Finanzdaten, Konjunkturtrends |

| SARIMA | Saisonale Autoregression, integrierter gleitender Durchschnitt | Klimadaten, saisonale Muster |

| VAR | Multivariate, Autoregression | Makroökonomische Modellierung |

| LSTM | Rekurrentes neuronales Netzwerk | Verarbeitung natürlicher Sprache |

| Transformator | Aufmerksamkeitsmechanismus, Parallelverarbeitung | Texterstellung, Übersetzung |

Autoregressive Modelle finden in vielen Bereichen Anwendung:

- Zeitreihenprognose: Vorhersage von Aktienkursen, Wettermustern oder Website-Verkehr.

- Verarbeitung natürlicher Sprache: Textgenerierung, Sprachübersetzung, Stimmungsanalyse.

- Bildgenerierung: Erstellen realistischer Bilder mithilfe von Generative Adversarial Networks (GANs).

- Musik Komposition: Erstellen neuer Musiksequenzen und Kompositionen.

- Anomalieerkennung: Identifizieren von Ausreißern in Zeitreihendaten.

Trotz ihrer Stärken weisen autoregressive Modelle einige Einschränkungen auf:

- Kurzzeitgedächtnis: Sie haben möglicherweise Schwierigkeiten, langfristige Abhängigkeiten in Daten zu erfassen.

- Überanpassung: Autoregressive Modelle höherer Ordnung neigen möglicherweise zu übermäßiger Anpassung an das Rauschen in den Daten.

- Datenstationarität: Modelle vom Typ ARIMA erfordern stationäre Daten, was in der Praxis eine Herausforderung darstellen kann.

Um diese Herausforderungen zu bewältigen, haben Forscher verschiedene Lösungen vorgeschlagen:

- Wiederkehrende neuronale Netze (RNNs): Sie bieten bessere Langzeitgedächtnisfunktionen.

- Regularisierungstechniken: Wird verwendet, um eine Überanpassung in Modellen höherer Ordnung zu verhindern.

- Saisonale Differenzierung: Zum Erreichen von Datenstationarität in saisonalen Daten.

- Aufmerksamkeitsmechanismen: Verbessern Sie die Handhabung von Abhängigkeiten über große Entfernungen in Transformer-Modellen.

Hauptmerkmale und andere Vergleiche mit ähnlichen Begriffen

Autoregressive Modelle werden häufig mit anderen Zeitreihenmodellen verglichen, wie zum Beispiel:

- Gleitender Durchschnitt (MA)-Modelle: Konzentrieren Sie sich ausschließlich auf die Beziehung zwischen dem aktuellen Wert und vergangenen Fehlern, während autoregressive Modelle die vergangenen Werte der Variablen berücksichtigen.

- Autoregressive Moving Average (ARMA)-Modelle: Kombinieren Sie die autoregressiven und gleitenden Durchschnittskomponenten und bieten Sie so einen umfassenderen Ansatz zur Modellierung von Zeitreihendaten.

- Autoregressive integrierte gleitende Durchschnittsmodelle (ARIMA): Integrieren Sie Differenzierung, um Stationarität in nichtstationären Zeitreihendaten zu erreichen.

Hier ist eine Vergleichstabelle, die die Hauptunterschiede zwischen diesen Zeitreihenmodellen hervorhebt:

| Modell | Hauptmerkmale | Anwendung |

|---|---|---|

| Autoregressiv (AR) | Regression gegenüber früheren Werten | Zeitreihenprognose |

| Gleitender Durchschnitt (MA) | Regression gegen Fehler der Vergangenheit | Rauschfilterung |

| Autoregressiver gleitender Durchschnitt (ARMA) | Kombination von AR- und MA-Komponenten | Zeitreihenprognose, Rauschfilterung |

| Autoregressiver integrierter gleitender Durchschnitt (ARIMA) | Differenzierung für Stationarität | Finanzdaten, Konjunkturtrends |

Autoregressive Modelle entwickeln sich weiter, angetrieben durch Fortschritte im Bereich Deep Learning und Verarbeitung natürlicher Sprache. Die Zukunft autoregressiver Modelle wird wahrscheinlich Folgendes beinhalten:

- Komplexere Architekturen: Forscher werden komplexere Netzwerkstrukturen und Kombinationen autoregressiver Modelle mit anderen Architekturen wie Transformern und LSTMs untersuchen.

- Aufmerksamkeitsmechanismen: Aufmerksamkeitsmechanismen werden verfeinert, um Fernabhängigkeiten in sequenziellen Daten zu verbessern.

- Effizientes Training: Es werden Anstrengungen unternommen, um den Rechenleistungsbedarf für das Training groß angelegter autoregressiver Modelle zu reduzieren.

- Unbeaufsichtigtes Lernen: Autoregressive Modelle werden für unüberwachte Lernaufgaben wie Anomalieerkennung und Repräsentationslernen verwendet.

Wie Proxyserver verwendet oder mit autoregressiven Modellen verknüpft werden können

Proxyserver können bei der Verbesserung der Leistung autoregressiver Modelle eine wichtige Rolle spielen, insbesondere in bestimmten Anwendungen:

- Datensammlung: Beim Sammeln von Trainingsdaten für autoregressive Modelle können Proxyserver verwendet werden, um Datenquellen zu anonymisieren und zu diversifizieren und so eine umfassendere Darstellung der Datenverteilung zu gewährleisten.

- Datenerweiterung: Proxyserver ermöglichen die Generierung zusätzlicher Datenpunkte durch den Zugriff auf verschiedene Online-Quellen und die Simulation verschiedener Benutzerinteraktionen, was zur Verbesserung der Generalisierung des Modells beiträgt.

- Lastverteilung: Bei groß angelegten Anwendungen können Proxyserver die Inferenzlast auf mehrere Server verteilen und so eine effiziente und skalierbare Bereitstellung autoregressiver Modelle gewährleisten.

- Privatsphäre und Sicherheit: Proxyserver fungieren als Vermittler zwischen Clients und Servern und bieten mithilfe autoregressiver Modelle eine zusätzliche Sicherheits- und Datenschutzebene für vertrauliche Anwendungen.

Verwandte Links

Weitere Informationen zu autoregressiven Modellen finden Sie in den folgenden Ressourcen:

- Zeitreihenanalyse: Prognose und Kontrolle von George Box und Gwilym Jenkins

- Netzwerke mit langem Kurzzeitgedächtnis (LSTM)

- Der illustrierte Transformer von Jay Alammar

- Eine Einführung in die Zeitreihenanalyse und Prognose in Python

Autoregressive Modelle sind zu einem grundlegenden Werkzeug für verschiedene datenbezogene Aufgaben geworden, da sie genaue Vorhersagen und eine realistische Datengenerierung ermöglichen. Mit fortschreitender Forschung auf diesem Gebiet können wir mit der Entstehung noch fortschrittlicherer und effizienterer Modelle rechnen, die die Art und Weise, wie wir in Zukunft mit sequentiellen Daten umgehen, revolutionieren werden.