自己回帰モデルは、自然言語処理、時系列分析、画像生成などのさまざまな分野で広く使用されている統計モデルの一種です。これらのモデルは、以前に観察された値に基づいて一連の値を予測するため、連続データを含むタスクに適しています。自己回帰モデルは、現実的なデータを生成し、将来の結果を予測するのに非常に効果的であることが証明されています。

自己回帰モデルの起源の歴史とその最初の言及

自己回帰の概念は 20 世紀初頭に遡り、1927 年に英国の統計学者ユールによって先駆的な研究が行われました。しかし、現代の自己回帰モデルの基礎を築いたのは、1940 年代の数学者ノーバート ウィーナーの研究でした。ウィーナーの確率過程と予測に関する研究は、今日知られているような自己回帰モデル開発の基礎を築きました。

「自己回帰」という用語は、1920 年代後半にラグナー・フリッシュによって初めて経済学の分野に導入されました。フリッシュはこの用語を、変数をそれ自身の遅れた値に対して回帰し、それによって変数自身の過去への依存性を捉えるモデルを説明するために使用しました。

自己回帰モデル: 詳細情報

自己回帰 (AR) モデルは時系列分析に不可欠なツールであり、履歴データに基づいて将来の値を予測するために使用されます。これらのモデルは、過去の値が現在の値と将来の値に線形に影響を与えると想定しています。これらは、時系列データが普及している経済、金融、天気予報、その他のさまざまな分野で広く使用されています。

数学的表現

順序の自己回帰モデル (AR(p))は数学的には次のように表現されます。

どこ:

- は、時刻における系列の値である。 .

- モデルの係数です。

- シリーズの過去の値です。

- は、時刻における誤差項である。 通常、平均がゼロで分散が一定のホワイトノイズであると想定されます。

順序の決定 (p)

オーダー ARモデルの選択は、モデルに含める過去の観測値の数を決定するため、非常に重要である。 トレードオフが伴います:

- 下位の順序 モデル(小型 ) では、データ内の関連するパターンをすべて捕捉できず、適合不足が発生する可能性があります。

- 高次の モデル(大型 ) はより複雑なパターンを捉えることができますが、モデルが基礎となるプロセスではなくランダムなノイズを記述する過剰適合のリスクがあります。

最適な順序を決定する一般的な方法 含む:

- 部分自己相関関数 (PACF): 含める必要がある重要なラグを識別します。

- 情報基準: 赤池情報量基準(AIC)やベイズ情報量基準(BIC)などの基準は、モデルの適合性と複雑さのバランスをとり、適切なものを選択します。 .

モデル推定

パラメータの推定 モデルを履歴データに適合させることが含まれます。これは、次のような手法を使用して行うことができます。

- 最小二乗推定: 観測値と予測値の間の二乗誤差の合計を最小化します。

- 最大尤度推定: 指定されたデータを観測する可能性を最大化するパラメータを見つけます。

モデル診断

AR モデルを適合させた後、その妥当性を評価することが重要です。主な診断チェックは次のとおりです。

- 残差分析: 残差 (エラー) がホワイト ノイズに似ていることを確認し、モデルによって説明されないパターンが残っていないことを示します。

- リュングボックステスト: 残差の自己相関のいずれかがゼロと有意に異なるかどうかを評価します。

アプリケーション

AR モデルは汎用性が高く、さまざまな分野で応用されています。

- 経済と金融株価、金利、経済指標の予測。

- 天気予報: 気温と降水パターンを予測します。

- エンジニアリング: 信号処理および制御システム。

- 生物統計学: 生物学的時系列データのモデリング。

利点と限界

利点:

- シンプルで実装が簡単。

- パラメータの明確な解釈。

- 短期予測に効果的です。

制限事項:

- 線形関係を前提とします。

- 季節性が強いデータや非線形パターンを持つデータには不十分な場合があります。

- 順序の選択に敏感 .

例

時系列データのAR(2)モデル(次数2)を考える。 ここで、時刻の値 前の 2 つの時点の値に依存し、係数はそれぞれ 0.5 と 0.2 です。

自己回帰モデルの主要な機能の分析

自動回帰モデルは、さまざまなアプリケーションにとって価値のあるいくつかの重要な機能を提供します。

- シーケンス予測: 自己回帰モデルは、時系列で将来の値を予測することに優れており、時系列予測に最適です。

- 生成機能これらのモデルは、トレーニング データに似た新しいデータ サンプルを生成できるため、データ拡張や、テキストや画像の生成などのクリエイティブ タスクに役立ちます。

- 柔軟性: 自己回帰モデルはさまざまなデータ型に対応でき、特定のドメインに限定されないため、さまざまな分野での応用が可能になります。

- 解釈可能性: モデルの構造が単純であるため、パラメーターと予測を簡単に解釈できます。

- 適応性: 自己回帰モデルは、変化するデータ パターンに適応し、時間の経過とともに新しい情報を組み込むことができます。

自己回帰モデルの種類

自己回帰モデルにはさまざまな形式があり、それぞれに独自の特徴があります。自己回帰モデルの主なタイプは次のとおりです。

- 移動平均自己回帰モデル (ARMA): 自動回帰コンポーネントと移動平均コンポーネントを組み合わせて、現在と過去の両方のエラーを考慮します。

- 自己回帰統合移動平均モデル (ARIMA): 差分を組み込むことで ARMA を拡張し、非定常時系列データの定常性を実現します。

- 季節的自己回帰統合移動平均モデル (SARIMA): ARIMA の季節バージョン。季節パターンのある時系列データに適しています。

- ベクトル自己回帰モデル (VAR): 自己回帰モデルの多変量拡張。複数の変数が相互に影響を与える場合に使用されます。

- 長短期記憶 (LSTM) ネットワーク: 逐次データ内の長距離依存関係をキャプチャできるリカレント ニューラル ネットワークの一種。自然言語処理や音声認識タスクでよく使用されます。

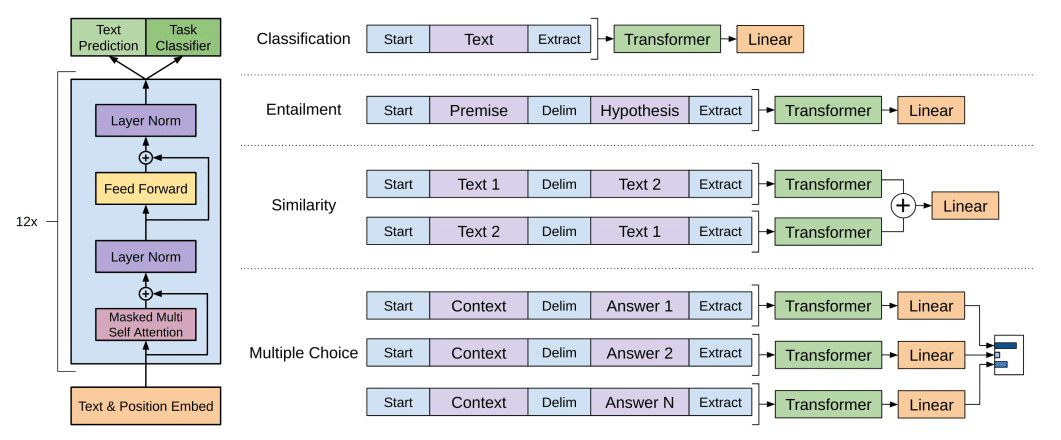

- 変圧器モデル: アテンション メカニズムを使用して連続データを処理するニューラル ネットワーク アーキテクチャの一種。言語翻訳とテキスト生成での成功で知られています。

これらの自己回帰モデルの主な特徴をまとめた比較表を次に示します。

| モデル | 主な特長 | 応用 |

|---|---|---|

| アルマ | 自己回帰、移動平均 | 時系列予測 |

| 有馬 | 自動回帰、統合、移動平均 | 財務データ、経済動向 |

| サリマ | 季節自動回帰、統合移動平均 | 気候データ、季節パターン |

| VAR | 多変量、自動回帰 | マクロ経済モデリング |

| LSTM | リカレント ニューラル ネットワーク | 自然言語処理 |

| 変成器 | アテンションメカニズム、並列処理 | テキストの生成、翻訳 |

自己回帰モデルは、幅広い分野で応用できます。

- 時系列予測: 株価、気象パターン、Web サイトのトラフィックを予測します。

- 自然言語処理: テキスト生成、言語翻訳、感情分析。

- 画像生成: 敵対的生成ネットワーク (GAN) を使用してリアルな画像を作成します。

- 作曲: 新しい音楽シーケンスと楽曲を生成します。

- 異常検出: 時系列データ内の外れ値を特定します。

自己回帰モデルには長所があるにもかかわらず、いくつかの制限があります。

- 短期記憶: データ内の長距離依存関係を把握するのに苦労する可能性があります。

- 過学習: 高次の自己回帰モデルは、データ内のノイズに過剰適合する可能性があります。

- データの定常性: ARIMA タイプのモデルには定常データが必要ですが、実際に達成するのは困難な場合があります。

これらの課題に対処するために、研究者はさまざまな解決策を提案しています。

- リカレント ニューラル ネットワーク (RNN): より優れた長期記憶能力を提供します。

- 正則化手法: 高次モデルの過学習を防ぐために使用されます。

- 季節の違い: 季節データのデータ定常性を実現します。

- 注意メカニズム: Transformer モデルにおける長距離依存関係の処理を改善しました。

主な特徴と類似用語との比較

自己回帰モデルは、次のような他の時系列モデルとよく比較されます。

- 移動平均 (MA) モデル: 自己回帰モデルは変数の過去の値を考慮するのに対し、現在の値と過去の誤差の関係のみに焦点を当てます。

- 自己回帰移動平均 (ARMA) モデル: 自動回帰コンポーネントと移動平均コンポーネントを組み合わせて、時系列データをモデル化するためのより包括的なアプローチを提供します。

- 自己回帰統合移動平均 (ARIMA) モデル: 差分を組み込んで、非定常時系列データの定常性を実現します。

これらの時系列モデル間の主な違いを強調した比較表を次に示します。

| モデル | 主な特長 | 応用 |

|---|---|---|

| 自己回帰 (AR) | 過去の値に対する回帰 | 時系列予測 |

| 移動平均 (MA) | 過去のエラーに対する回帰 | ノイズフィルタリング |

| 自己回帰移動平均 (ARMA) | AR コンポーネントと MA コンポーネントの組み合わせ | 時系列予測、ノイズフィルタリング |

| 自己回帰統合移動平均 (ARIMA) | 定常性の差分 | 財務データ、経済動向 |

自己回帰モデルは、深層学習と自然言語処理の進歩によって進化し続けています。自己回帰モデルの将来には、次のようなことが起こる可能性があります。

- より複雑なアーキテクチャ: 研究者は、より複雑なネットワーク構造と、自己回帰モデルとトランスフォーマーや LSTM などの他のアーキテクチャとの組み合わせを調査します。

- 注意メカニズム: アテンション メカニズムが改良され、シーケンシャル データの長距離依存関係が強化されます。

- 効率的なトレーニング: 大規模な自己回帰モデルをトレーニングするための計算要件を削減するための努力が行われます。

- 教師なし学習: 自己回帰モデルは、異常検出や表現学習などの教師なし学習タスクに使用されます。

プロキシ サーバーの使用方法または自動回帰モデルとの関連付け方法

プロキシ サーバーは、特に特定のアプリケーションにおいて、自動回帰モデルのパフォーマンスを向上させる上で重要な役割を果たします。

- データ収集: 自己回帰モデルのトレーニング データを収集する場合、プロキシ サーバーを使用してデータ ソースを匿名化および多様化し、データ分布をより包括的に表現できます。

- データ拡張: プロキシ サーバーを使用すると、さまざまなオンライン ソースにアクセスし、さまざまなユーザー インタラクションをシミュレートすることで追加のデータ ポイントを生成できるようになり、モデルの一般化の向上に役立ちます。

- ロードバランシング: 大規模なアプリケーションでは、プロキシ サーバーによって推論負荷が複数のサーバーに分散され、自動回帰モデルの効率的かつスケーラブルな展開が保証されます。

- プライバシーとセキュリティ: プロキシ サーバーはクライアントとサーバーの間の仲介者として機能し、自動回帰モデルを使用して機密性の高いアプリケーションにセキュリティとプライバシーの追加層を提供します。

関連リンク

自動回帰モデルの詳細については、次のリソースを参照してください。

- 時系列分析: 予測と制御 by George Box および Gwilym Jenkins

- 長短期記憶 (LSTM) ネットワーク

- ジェイ・アランマーのイラスト付きトランスフォーマー

- Python による時系列分析と予測の概要

自己回帰モデルは、さまざまなデータ関連タスクの基本ツールとなり、正確な予測と現実的なデータ生成を可能にします。この分野の研究が進むにつれて、さらに高度で効率的なモデルが登場し、将来のシーケンシャルデータの処理方法に革命をもたらすことが期待されます。