Un server cache è un componente critico della moderna infrastruttura web progettata per migliorare le prestazioni e l'efficienza dei servizi web. Memorizza temporaneamente i dati a cui si accede di frequente, riducendo la necessità di recuperare ripetutamente le stesse informazioni dalla fonte originale. In questo modo, i server cache accelerano notevolmente il recupero dei dati e migliorano l'esperienza complessiva dell'utente.

La storia dell'origine del Cache Server e la prima menzione di esso

Il concetto di memorizzazione nella cache risale agli albori dell'informatica, quando la memoria e lo spazio di archiviazione erano limitati. La prima menzione del caching risale al sistema operativo Multics negli anni '60. Utilizzava la memoria cache per archiviare i dati a cui si accedeva di frequente, riducendo il tempo necessario per accedere alle informazioni dalla memoria principale più lenta o dall'archiviazione su disco.

Nel corso degli anni, con la crescita di Internet e dei servizi web, la necessità di memorizzazione nella cache è diventata sempre più evidente. Negli anni '90, con l'avvento del World Wide Web, i browser web iniziarono a implementare la memorizzazione nella cache per memorizzare gli elementi delle pagine web, consentendo caricamenti più rapidi delle pagine durante le visite successive.

Informazioni dettagliate sul server cache. Espansione dell'argomento Server cache

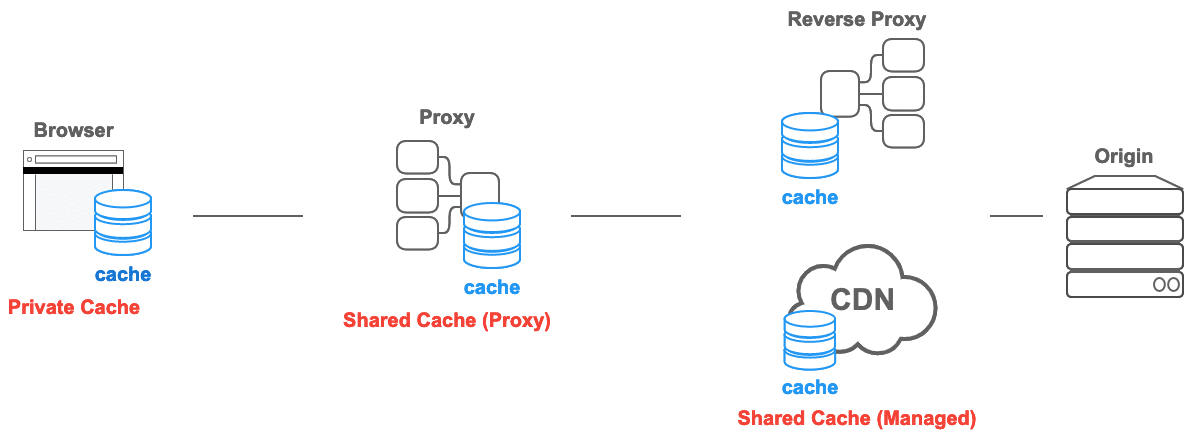

Un server cache è un hardware o software specializzato che archivia copie dei dati richiesti di frequente dalla fonte originale per soddisfare le richieste future in modo più efficiente. Quando un utente accede a un sito Web o richiede una particolare risorsa, come immagini, video o file, il server cache intercetta la richiesta.

Se la risorsa richiesta è presente nella cache, il cache server la consegna direttamente all'utente senza bisogno di recuperarla dal server originale. Questo processo riduce significativamente la latenza e il consumo di larghezza di banda, poiché i dati percorrono una distanza più breve, portando a tempi di risposta più rapidi.

I server di cache utilizzano varie tecniche di memorizzazione nella cache, come ad esempio:

- Cache Web: memorizzazione nella cache delle pagine Web e degli elementi associati (HTML, CSS, JavaScript) per accelerare il caricamento del sito Web per gli utenti.

- Rete per la distribuzione dei contenuti (CDN): i CDN sono un tipo di rete di server cache distribuita che archivia e fornisce contenuti da più posizioni in tutto il mondo. I CDN aiutano a ridurre al minimo la latenza e garantiscono una distribuzione più rapida dei contenuti, soprattutto per gli utenti geograficamente dispersi.

- Caching del database: memorizzazione nella cache delle query e dei risultati del database a cui si accede frequentemente per accelerare il recupero dei dati per le applicazioni.

- Memorizzazione nella cache dell'API: memorizzazione nella cache delle risposte delle API per ridurre il sovraccarico sui server backend e migliorare i tempi di risposta delle API.

La struttura interna del server cache. Come funziona il server di cache

La struttura interna di un server cache coinvolge in genere i seguenti componenti:

- Negozio di cache: qui è dove vengono archiviati i dati memorizzati nella cache. Può essere implementato utilizzando diversi supporti di memorizzazione come RAM, SSD o una combinazione di entrambi, a seconda dei requisiti di velocità di accesso.

- Gestore della cache: il gestore della cache gestisce l'inserimento, l'eliminazione e il recupero dei dati dall'archivio cache. Utilizza algoritmi di memorizzazione nella cache per determinare quali elementi conservare e quali sostituire quando la cache raggiunge il limite di capacità.

- Meccanismo di aggiornamento della cache: il server cache deve essere sincronizzato con il server originale per garantire che contenga la versione più recente dei dati. Questa operazione viene solitamente eseguita utilizzando tecniche di invalidazione o scadenza della cache.

- Interfaccia di controllo della cache: un server di cache fornisce spesso un'interfaccia o un'API per gestire e controllare il comportamento della memorizzazione nella cache, ad esempio la configurazione delle regole della cache, la cancellazione della cache o l'eliminazione di specifici elementi memorizzati nella cache.

Il flusso di lavoro tipico di un server cache prevede:

- Un utente richiede una risorsa da un sito Web o un'applicazione.

- Il server cache intercetta la richiesta e controlla se la risorsa è disponibile nel suo archivio cache.

- Se la risorsa viene trovata nella cache, il server della cache la consegna direttamente all'utente.

- Se la risorsa non è nella cache o è scaduta, il server della cache la recupera dal server originale, ne archivia una copia nell'archivio della cache e quindi la consegna all'utente.

- Il server della cache aggiorna regolarmente il proprio archivio cache per garantire l'accuratezza e la pertinenza dei dati.

Analisi delle caratteristiche principali del Cache Server

I server di cache offrono diverse funzionalità chiave a vantaggio sia dei servizi Web che degli utenti:

- Prestazione migliorata: riducendo i tempi di recupero dei dati, i server cache garantiscono tempi di risposta più rapidi, tempi di caricamento delle pagine più brevi e un'esperienza utente complessivamente migliore.

- Risparmio di larghezza di banda: i dati memorizzati nella cache vengono serviti localmente, riducendo al minimo la necessità di ripetuti trasferimenti di dati tra l'utente e il server originale. Ciò riduce il consumo e i costi della larghezza di banda.

- Riduci il carico del server: poiché i server cache gestiscono una parte significativa delle richieste, il carico sul server originale diminuisce, consentendogli di concentrarsi su altre attività critiche.

- Tolleranza agli errori: i server cache possono fungere da buffer durante le interruzioni temporanee del server. Se il server originale non funziona, il server cache può continuare a servire il contenuto memorizzato nella cache finché il server originale non torna online.

- Distribuzione geografica: i CDN, un tipo di rete di server cache, possono replicare i contenuti in più posizioni a livello globale, garantendo una distribuzione rapida e affidabile dei contenuti agli utenti di tutto il mondo.

Tipi di server di cache

I server di cache possono essere classificati in base al loro scopo e al tipo di dati che memorizzano nella cache. Ecco alcuni tipi comuni:

| Tipo | Descrizione |

|---|---|

| Cache Web | Memorizza gli elementi della pagina Web (HTML, CSS, JavaScript) per accelerare il caricamento del sito Web. |

| CDN | Server di cache distribuiti che forniscono contenuti da più località in tutto il mondo. |

| Cache del database | Memorizza nella cache le query e i risultati del database a cui si accede di frequente per un recupero dei dati più rapido. |

| Cache dell'API | Memorizza nella cache le risposte delle API per migliorare i tempi di risposta delle API e ridurre il carico del backend. |

| Cache dei contenuti | Memorizza nella cache i contenuti multimediali (immagini, video) per ridurre i tempi di caricamento e l'utilizzo della larghezza di banda. |

Modi per utilizzare il server cache:

- Accelerazione web: i server cache vengono utilizzati per accelerare il caricamento del sito Web per gli utenti, riducendo la frequenza di rimbalzo e migliorando il posizionamento SEO.

- Distribuzione dei contenuti: i CDN memorizzano nella cache e distribuiscono i contenuti a più edge location, garantendo una distribuzione dei contenuti più rapida e affidabile.

- Prestazioni del database: La memorizzazione nella cache delle query del database a cui si accede frequentemente può migliorare significativamente le prestazioni dell'applicazione e ridurre il carico del database.

Problemi e soluzioni:

- Cache obsoleta: i dati memorizzati nella cache potrebbero diventare obsoleti o obsoleti. I server di cache utilizzano tecniche di scadenza o invalidamento della cache per garantire che il contenuto obsoleto non venga fornito agli utenti.

- Sfide di invalidamento della cache: quando i dati originali vengono aggiornati, l'invalidazione della cache può essere complessa e richiedere un'attenta gestione per evitare di fornire informazioni obsolete.

- Dimensioni della cache e criteri di eliminazione: i server di cache hanno una capacità di archiviazione limitata e la selezione di policy di eliminazione efficienti è essenziale per mantenere i dati più rilevanti nella cache.

Caratteristiche principali e altri confronti con termini simili

| Caratteristica | Server di cache | Bilanciatore del carico | Server proxy |

|---|---|---|---|

| Funzione | Memorizzazione nella cache dei dati a cui si accede frequentemente per velocizzare il recupero. | Distribuire il traffico su più server per bilanciare il carico. | Agire come intermediario tra client e server, inoltrando le richieste. |

| Scopo | Ottimizza i tempi di accesso ai dati e riduci il carico del server. | Garantire una distribuzione uniforme del traffico, prevenendo il sovraccarico del server. | Migliora la sicurezza, la privacy e le prestazioni per client e server. |

| Tipo | Software o hardware. | Tipicamente basato su software. | Software o hardware. |

| Esempi | Vernice, calamaro. | HAProxy, NGINX. | Apache, Nginx. |

Il futuro dei server cache è promettente, guidato dai progressi nelle tecnologie hardware e software. Alcune tendenze e tecnologie chiave includono:

- Informatica perimetrale: L'avvento dell'edge computing porterà all'implementazione di server cache più vicini agli utenti finali, riducendo la latenza e migliorando ulteriormente le prestazioni.

- Apprendimento automatico: i server di cache possono sfruttare algoritmi di machine learning per prevedere il comportamento degli utenti e memorizzare proattivamente i dati nella cache, migliorando i tassi di successo della cache.

- Caching immutabile: La memorizzazione nella cache immutabile garantisce che il contenuto memorizzato nella cache rimanga invariato, risolvendo i problemi di coerenza della cache.

- Caching dei dati in tempo reale: La memorizzazione nella cache dei flussi di dati in tempo reale diventerà fondamentale per applicazioni come l'IoT, dove la bassa latenza è essenziale.

Come i server proxy possono essere utilizzati o associati al server cache

I server proxy e i server cache vengono spesso utilizzati insieme per migliorare le prestazioni Web, la sicurezza e la privacy. I server proxy fungono da intermediari tra client e server, mentre i server cache archiviano i dati a cui si accede frequentemente per accelerarne il recupero. La combinazione delle due tecnologie offre numerosi vantaggi:

- Proxy di memorizzazione nella cache: i server proxy possono essere configurati come proxy di memorizzazione nella cache, consentendo loro di memorizzare nella cache il contenuto e di fornirlo ai client senza contattare ripetutamente il server originale.

- Bilanciamento del carico e memorizzazione nella cache: i bilanciatori del carico distribuiscono le richieste dei client su più server, mentre i proxy di memorizzazione nella cache riducono il carico del server fornendo il contenuto memorizzato nella cache.

- Sicurezza e anonimato: i server proxy possono rendere anonime le richieste dei client e i server cache possono archiviare in modo sicuro le risorse richieste di frequente.

Link correlati

Per ulteriori informazioni sui server cache, è possibile fare riferimento alle seguenti risorse:

- Tutorial sulla memorizzazione nella cache per autori Web e webmaster

- Come funzionano i CDN

- La documentazione del server HTTP Apache

Ricorda, i server cache sono un componente fondamentale nell'architettura web moderna, poiché ottimizzano il recupero dei dati e migliorano l'esperienza utente complessiva. Implementando strategicamente i server cache, i siti Web e le applicazioni possono ottenere tempi di caricamento più rapidi, un minore utilizzo della larghezza di banda e ridurre il carico sui server di origine, con conseguente maggiore soddisfazione degli utenti e maggiore efficienza per i fornitori di servizi Web.